Sự việc đi đến hồi kết, nhưng đến giờ OpenAI vẫn chưa công bố lý do chính đáng.

Đã gần một tuần sau khi Sam Altman, CEO của OpenAI, bị hội đồng quản trị sa thải không rõ lý do, dư luận vẫn chưa tìm được lời giải thích hợp lý cho sự vụ gây tranh cãi. Ngay cả khi Altman quay trở lại vị trí CEO, sự tình cũng chẳng rõ ràng hơn.

Ngoài tuyên bố rằng Altman đã không “thẳng thắn trong việc liên lạc với hội đồng, làm cản trở khả năng thực hiện trách nhiệm”, thì cho đến giờ hội đồng vẫn im hơi lặng tiếng. Trong khi đó, một phần không nhỏ nhân viên OpenAI đã phản ứng dữ dội trước quyết định của ban lãnh đạo: họ sẵn sàng nối gót Sam Altman ra đi, trừ khi vị cựu CEO được tái bổ nhiệm.

Trong khi chờ thông tin chính thức, dư luận chỉ có thể suy luận tình hình nội bộ, dựa trên những thông tin bên lề và những tuyên bố từng được OpenAI đưa ra.

Từ trái sang phải: Greg Brockman, đồng sáng lập và CTO của OpenAI; Ilya Sutskever, đồng sáng lập và trưởng ban khoa học; Dario Amodei, giám đốc nghiên cứu.

Samuel Altman, CEO của OpenAI.

Rất nhiều người hoài nghi sự vụ có dính dáng tới mối liên hệ giữa Sam Altman và quá trình phát triển AGI (artificial general intelligence, hay tạm dịch là “trí tuệ nhân tạo tổng quát”), họ cho rằng AGI do OpenAI đang phát triển chính là lý do dẫn tới sự việc sa thải bất ngờ. Phải làm rõ, ngay từ khi Sam Altman trở thành CEO của OpenAI vào năm 2019 (một năm sau khi Elon Musk rời đi), anh đã đặt ra mục tiêu phát triển một AGI có ích cho nhân loại.

Liệu có phải OpenAI chủ động cắt đứt quan hệ với Sam Altman vì anh đang cho phép tạo ra một sản phẩm có hại?

Không có bằng chứng cho thấy điều đó, tuy nhiên không thể phủ nhận khả năng này, khi người dùng trí tuệ nhân tạo nói chung hay ChatGPT nói riêng đã nhìn ra những tình huống mà tại đó, con người có thể bị AI làm hại.

Chưa hết, giới nghiên cứu còn chưa thống nhất về định nghĩa của một “trí tuệ nhân tạo tổng quát”. Đa số các chuyên gia vẫn cho rằng AGI xuất hiện khi nó đã có thể thực hiện các tác vụ thông minh tương đương với con người.

Altman và Sutskever tại một buổi họp báo.

Còn theo định nghĩa của chính OpenAI, thì AGI là một “hệ thống vượt khả năng của con người trong hầu hết những công việc tạo ra giá trị kinh tế”. Định nghĩa nghe vô cùng … tầm thường so với những gì Sam Altman mới phát biểu trong bài phỏng vấn với Financial Times, khi ông gọi AGI là “trí tuệ thần kỳ ngụ trên trời”. Không rõ Altman ví von việc AGI vận hành trên công nghệ “đám mây”, hay ám chỉ AGI tương lai tương đương với thánh thần ngự trên cao.

Có lý do để dư luận nghi vấn, rằng Sam Altman ám chỉ AGI sẽ trở thành một công nghệ mang sức mạnh phi thường. Trong bài viết đăng tải trên The Atlantic, ông Ilya Sutskever – nhà khoa học máy tính, trưởng ban khoa học của OpenAI – thừa nhận mình đảm nhiệm vai trò “lãnh đạo tâm linh” của chặng đường đưa AGI lên tầm cao chưa từng có. Cũng theo The Atlantic, có những dịp nhân viên OpenAI hô lớn khẩu ngữ “Cảm nhận AGI! Cảm nhận AGI!”, với người khởi xướng chính là Sutskever.

Và mờ ám hơn cả, chính Ilya Sutskever là nhân vật chủ chốt đứng sau quyết định sa thải Sam Altman. Dù rằng Sutskever đã đăng đàn xin lỗi, và rằng ông không cố tình quấy rối nội bộ OpenAI, nhưng sự việc đã rồi và OpenAi vẫn đang quay cuồng trong sức ép bốn bề.

Sản phẩm thành công và được biết đên rộng rãi nhất của OpenAI: ChatGPT.

Quay trở lại với những hy vọng và lo ngại xoay quanh AGI. Nhiều người đồn đoán rằng hội đồng quản trị vội vàng sa thải Sam Altman bởi lẽ ông hành xử thiếu thận trọng trong quá trình phát triển một hệ thống giàu tiềm năng/tiềm ẩn nhiều nguy cơ như AGI. Nếu như nhận định này đúng, thì có vẻ OpenAI đang tiến ngày một gần tới mục tiêu họ đặt ra, là sáng tạo thành công một AGI đích thực.

Chừng nào khi OpenAI (hay bất cứ tổ chức nghiên cứu trí tuệ nhân tạo nào khác) chưa công bố một sản phẩm hoàn thiện, đồng thời xuất bản loạt báo cáo chứng minh sức mạnh của AGI, thì chuyên gia trong ngành vẫn sẽ còn hoài nghi. Khi Altman công bố bài blog nói về sứ mệnh phát triển AGI “có ích cho nhân loại”, các chuyên gia đã không mấy ấn tượng với lời lẽ của vị CEO.

“Khái niệm AGI quá ư bão hòa, việc bừa bãi nhắc tới nó có thể gây hiểu lầm, mặc dù nó là một thứ có thật và mang một nghĩa thật”, giáo sư toán học Noah Giansiracusa, công tác tại Đại học Bentley, nhận định. “Đây không phải khái niệm khoa học, mà là chiêu trò quảng cáo thì đúng hơn”.

Giáo sư ngôn ngữ học Emily Bender công tại tại Đại học Washington đồng tình với nhận định trên. Bà cho rằng thứ AGI mà OpenAI đang phát triển “không phải AGI, cũng không phải bước tiến gần hơn tới AGI, vậy mà [Sam Altman] cứ nhắc đến như như thể người đọc sẽ cứ gật đồng chấp thuận vậy”.

Về cơ bản, cả dư luận và giới chuyên môn đều hoài nghi trước khẳng định của OpenAI, nhất là khi thấy những mô hình ngôn ngữ lớn cao cấp của OpenAI (là những hệ thống tạo nên sức mạnh của ChatGPT) vẫn còn mắc sai lầm. Với những gì chúng ta đang thấy, thì chặng đường kiến tạo thành công một AGI vẫn còn xa vời và gian nan lắm.

Trả lời bài xin lỗi của Sutskever, Elon Musk có đôi lời như sau:

Ilya Sutskever: “Từ thâm tâm tôi lấy làm tiếc vì đã góp tiếng nói trong quyết định của hội đồng. Tôi không bao giờ muốn làm hại OpenAI. Tôi yêu mến mọi thứ chúng tôi đã cùng nhau gây dựng nên, và sẽ làm mọi thứ để gắn kết công ty lại“.

Elon Musk: “Tại sao ông lại hành động cực đoan như vậy? Nếu như OpenAI đang làm việc gì có khả năng gây nguy hiểm cho nhân loại, thế giới cần được biết.”

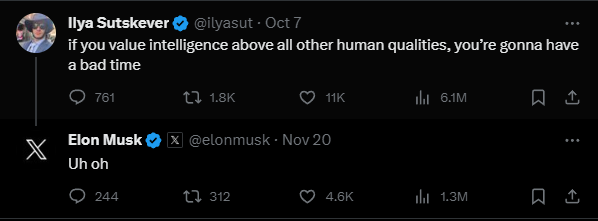

Cũng trong sự kiện lần này, Elon Musk lục lại bài đăng của chính Ilya Sutskever cách đây không lâu để mỉa mai.

Ilya Sutskever: “Nếu như bạn đặt giá trị của trí tuệ lên hơn hết thảy các giá trị của con người, bạn sẽ gặp rắc rối to“.

Elon Musk: “Á à“.

Hiện tại, vụ việc sa thải tại OpenAI đã tạm khép lại, với “phần thắng” nghiêng về phía Sam Altman. Ông đã được phục chức CEO, nhưng có thể chưa chắc sẽ tiếp tục tín nhiệm Ilya Sutskever hay những người đã bỏ phiếu chống lại mình.

Tương lai nhân sự OpenAI vẫn còn là dấu hỏi, và với hiện trạng này chúng ta sẽ không thể trông đợi một AGI hoàn thiện được trong nay mai.

Nguồn: Theo Đời sống Pháp luật